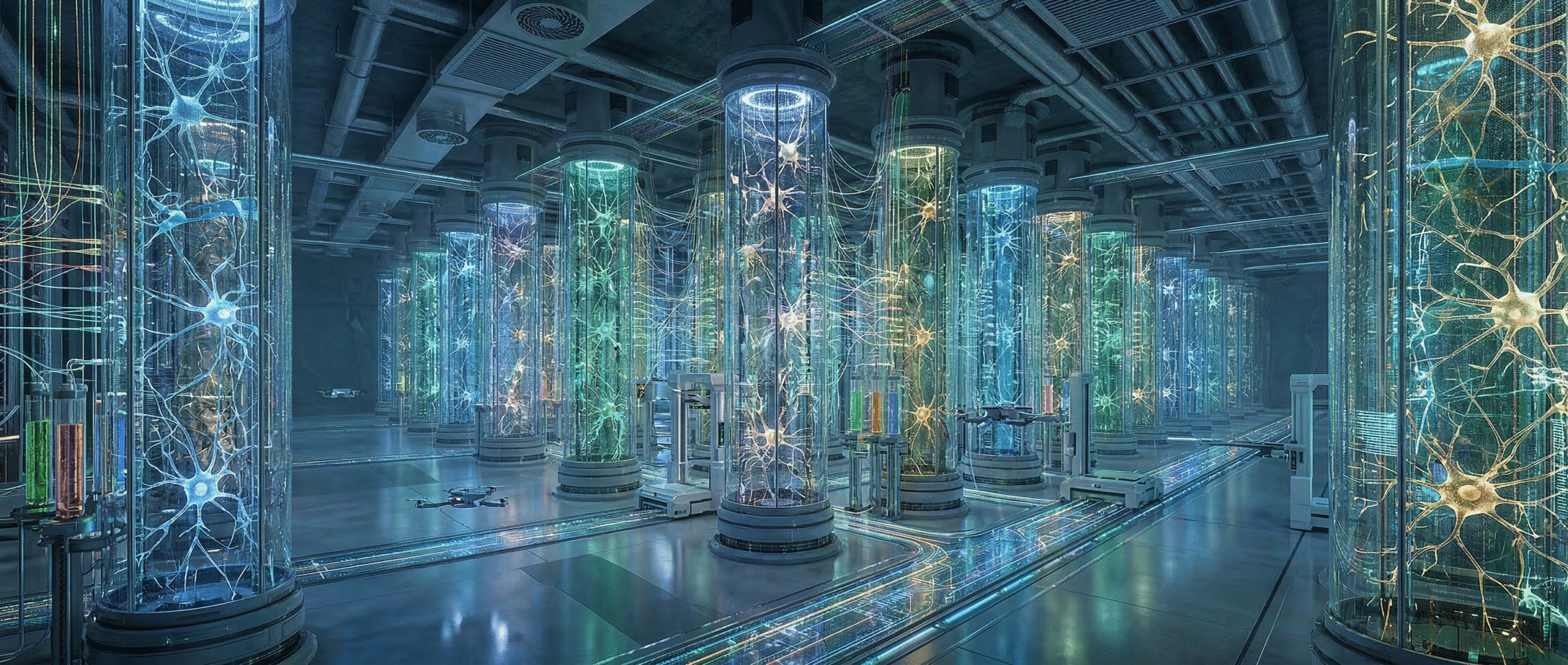

Биопроцессоры: дата-центры на клетках мозга

Стартап Cortical Labs начал строительство двух дата-центров, в которых вычисления будут выполняться с помощью живых клеток человеческого мозга. Об этом сообщает Bloomberg.

Технология использует нейроны, выращенные в лаборатории из стволовых клеток. Их помещают на специальные кремниевые чипы, которые стимулируют ткань электрическими импульсами и считывают её ответ. Специальное программное обеспечение интерпретирует эту нейронную активность как результат вычислений, создавая гибридную систему, где живая биологическая ткань выступает в роли процессора.

Главным преимуществом такого подхода разработчики называют чрезвычайно низкое энергопотребление. По словам основателя стартапа Хон Венг Чонга, каждый вычислительный модуль CL1 потребляет меньше энергии, чем карманный калькулятор.

Первый такой дата-центр уже создан в Мельбурне, а второй строится в Сингапуре совместно с партнёром DayOne Data Centers. В Мельбурне разместят 120 модулей CL1, а в Сингапуре планируют установить до 1000 единиц. Хотя эта технология пока не может заменить традиционные серверы, она предлагает альтернативный путь для решения проблемы растущего дефицита вычислительных мощностей и высокого энергопотребления в эпоху бума искусственного интеллекта.

Системы Cortical Labs продолжают развиваться. Ранее компания обучила нейроны играть в Pong, а в феврале этого года биологическая система смогла взаимодействовать с классической видеоигрой Doom.

Это не единственный пример биокомпьютинга. В августе 2024 года швейцарская компания FinalSpark создала компьютерную архитектуру из органоидов мозга и начала сдавать её мощности в аренду. Китайские учёные также разработали робота с искусственным мозгом, выращенным в лаборатории.